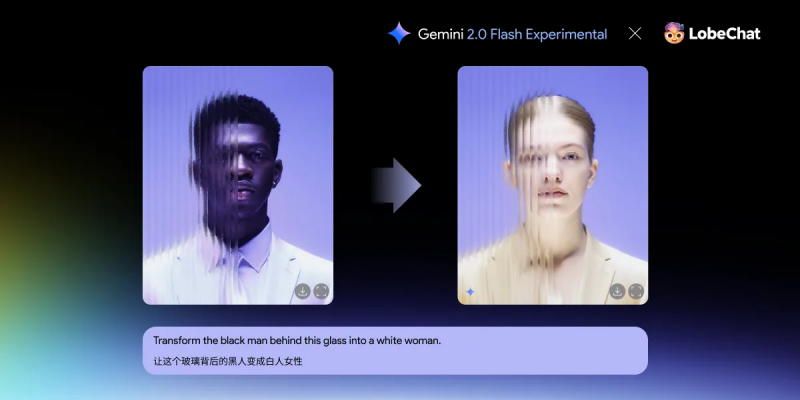

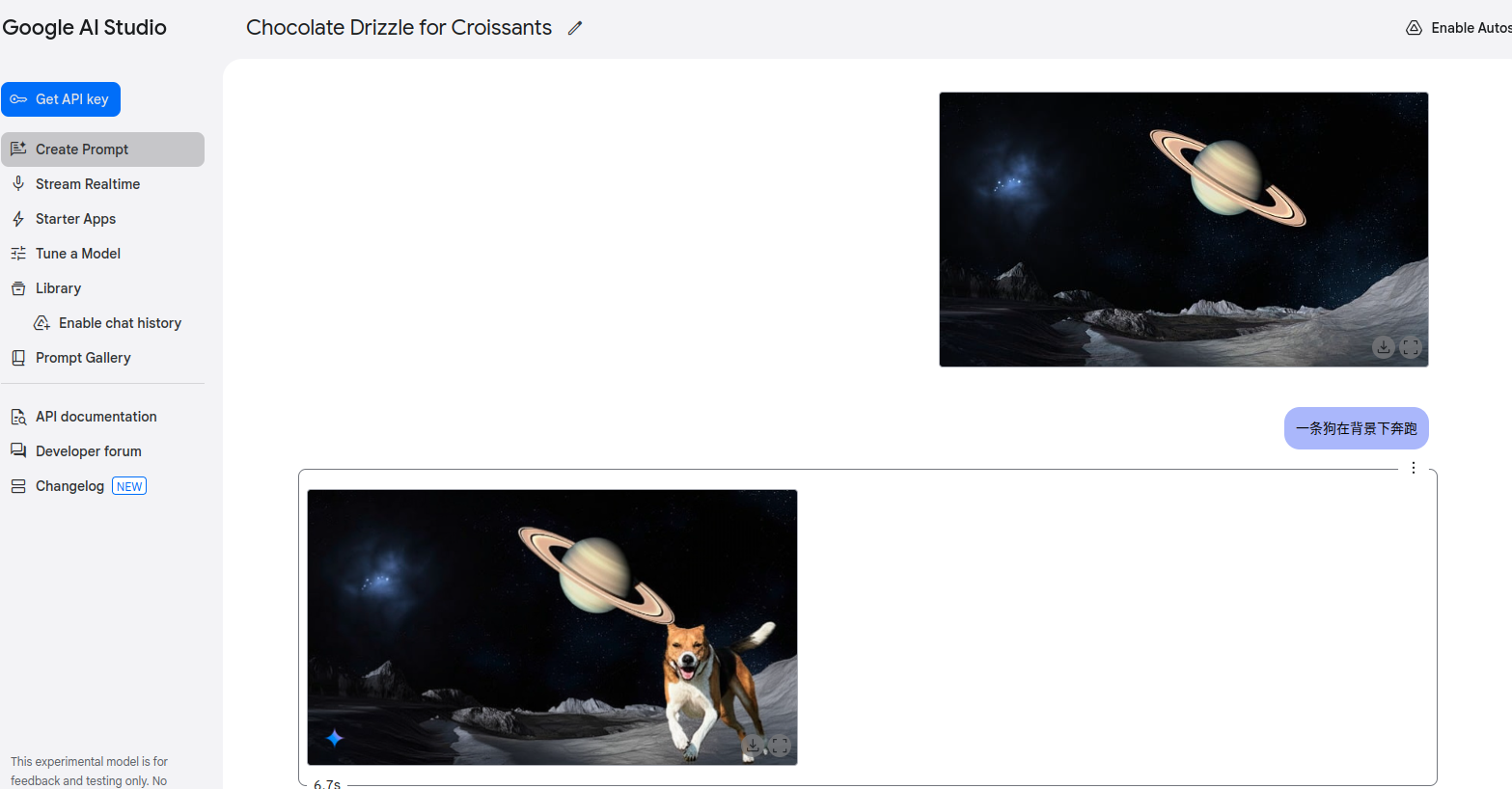

确实炸裂!AI的发展在25年大爆发。Google 最新发布的 Gemini 2.0 Flash Experimental 模型在图像生成方面非常牛x,输入文字交互做图、改图,为用户带来了全新的图文创作体验。

Gemini 2.0 Flash 的原生图像生成能力

2025 年 3 月 12 日,Google 正式向开发者开放了 Gemini 2.0 Flash Experimental 的图像生成功能。与其他 AI 模型不同,Gemini 2.0 Flash 可以直接生成图像,无需依赖外部工具或 API,真正实现了多模态输出。

Gemini 2.0 Flash 的核心优势

作为 Google 最新的多模态模型,Gemini 2.0 Flash 具备以下几个显著特点:

原生多模态输出:可以在一次 API 调用中生成包含文本和图像的混合内容。

强大的上下文理解能力:利用丰富的世界知识和增强的推理能力,生成与上下文高度相关的图像。

百万 Token 的上下文窗口:支持长文本理解,适应复杂场景。

低延迟高性能:专为快速响应和出色性能而设计,提升用户体验。

与其他图像生成模型的对比

与其他主流图像生成模型相比,Gemini 2.0 Flash Experimental 在以下几个方面表现更为优越:

Gemini 2.0 Flash 特别擅长生成与上下文高度相关的图像,比如为食谱创建真实的插图,或者为博客文章生成紧密相关的配图。

Gemini 2.0 Flash Experimental 图像生成功能详解

支持的图像生成模式

Gemini 2.0 Flash Experimental 支持多种图像生成模式,满足不同的需求:

文本到图像转换:根据文字描述生成相应的图像。

示例提示词: “生成一张埃菲尔铁塔与烟花的图像。”

文本与图像混合输出:生成包含文字和图像的内容。

-

示例提示词: “生成一份西班牙海鲜饭的图文菜谱。”

图像编辑:对已有图像进行修改和优化。

-

示例提示词: “将这张图像转换为卡通风格。”

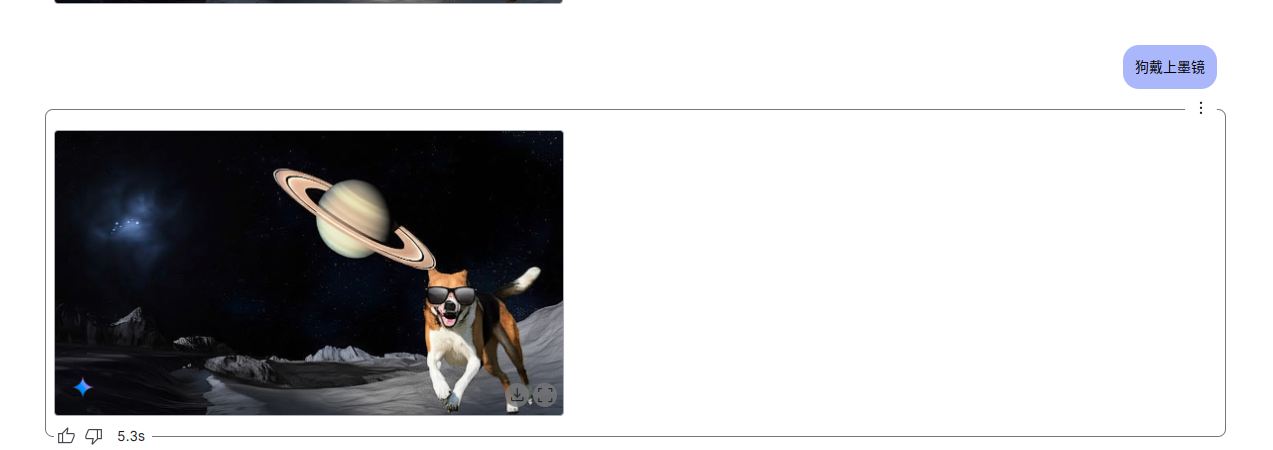

多轮图像编辑:在对话中持续修改和优化图像。

-

示例提示词: (上传蓝色汽车图像) “把这辆车变成敞篷车。” “现在把颜色改为黄色。”

多图像合成:结合多个输入图像创建新内容。

-

示例提示词: (猫的图像) + (枕头的图像) + “在这个枕头上创建我的猫的十字绣图案。”

图像生成的技术特点

我实验了一下,感觉PS工程师要失业了:

Gemini 2.0 Flash 的图像生成能力基于以下技术:

世界知识整合:模型利用其广泛的知识,生成准确且符合现实的图像内容。

增强推理能力:能够理解复杂的提示词,生成符合逻辑的图像。

文本渲染优化:特别优化了图像中的文本渲染,确保生成的图像中文字清晰可见。

SynthID 水印:所有生成的图像都带有 SynthID 水印,确保内容可追溯和安全。

当前限制与最佳实践

尽管 Gemini 2.0 Flash Experimental 功能强大,但仍存在一些限制:

语言支持:目前表现最佳的语言包括英语、西班牙语(墨西哥)、日语、中文和印地语。

输入限制:不支持音频或视频输入进行图像生成。

并发限制:同时请求的数量有限,每天有使用额度限制。

生成不确定性:模型可能不总是生成图像,有时可能只输出文本。

生成中断:在某些情况下,模型可能在生成过程中停止。

为了获得最佳效果,建议:

清晰明确地要求生成图像(例如,使用“生成一张图像”或“提供图像”等指令)。

对于包含文本的图像,先生成文本,然后再请求为文本创建图像。

有人问怎么用,那首先你得会科学上网(不会可以论坛咨询),或者直接用[http://librechat.chatgpt5x.com/]